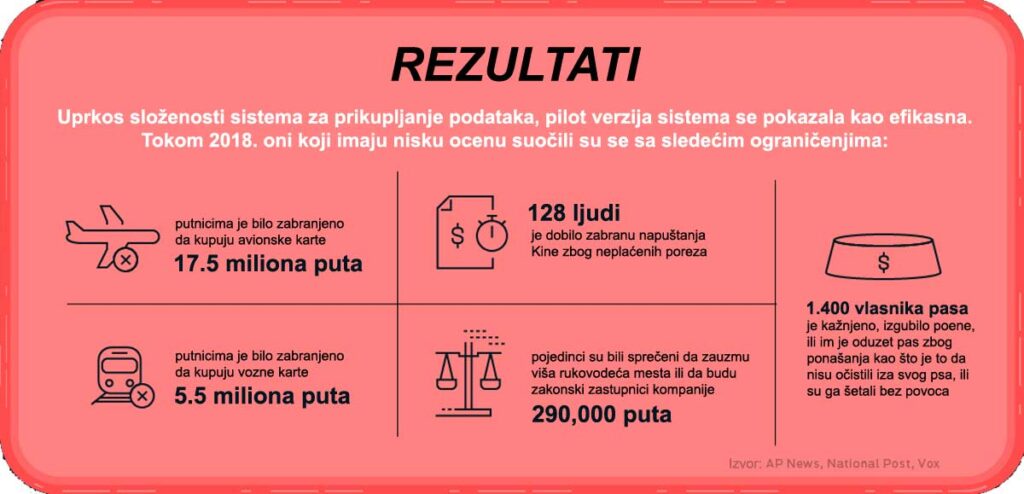

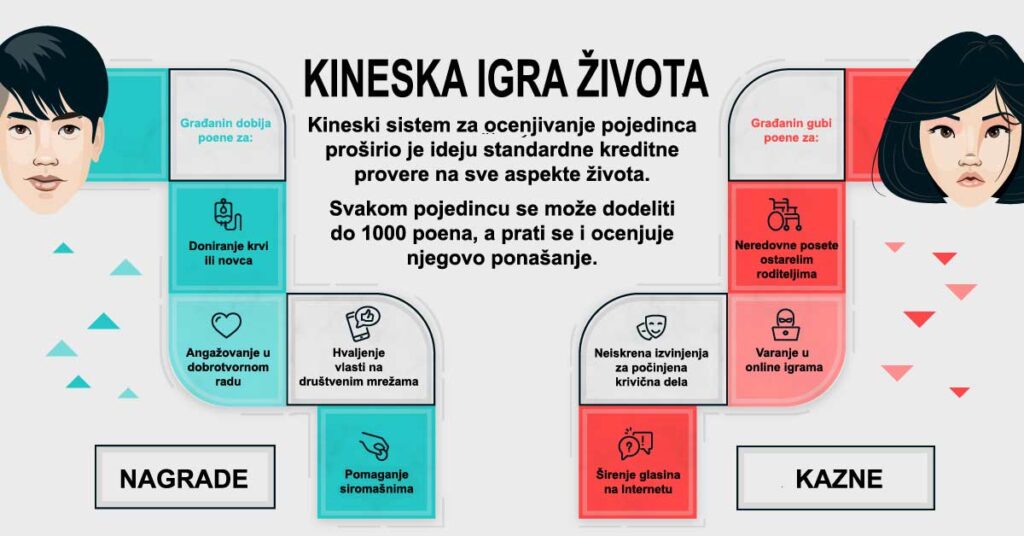

Social scoring je relativno nov pojam. Prevodimo ga kao „društvena ocena“, a poreklo onoga što nas ovde zanima je u Kini. Tamo je pre nekoliko godina počelo da se eksperimentiše sa tzv. društvenim kreditnim sistemom. Taj program je inicirao zvanične regionalne pilot probe tokom 2009. i predstavlja razvoj nacionalne „crne liste“ koju razvija kineska vlada. Nosilac je narodna banka Kine uz još osam firmi koje se bave kreditnim ocenjivanjem. Suština je uspostavljanju jedinstvenog evidencionog sistema za pojedince, preduzeća i vladu kako bi se pratila i procenila pouzdanost. Formalno je uvedena 2011. na oktobarskom zasedanju Državnog veća Kine.

Prvi izveštaji kažu da je sistem koristio numeričku ocenu kao mehanizam nagrade i kazne. Noviji izveštaji tvrde da se, zapravo, eksperimentiše sa više različitih oblika sistema socijalnog kredita. Prvobitni numerički sistem je implementiran samo u nekoliko regionalnih pilot programa, dok je nacionalni regulatorni metod zasnovan prvenstveno na crnim i belim listama. Ovaj kreditni sistem je blisko povezan sa kineskim sistemima masovnog nadzora, poput Skajneta, koji uključuje sistem za prepoznavanje lica, tehnologiju analize velikih podataka, veštačku inteligenciju i Projekat Maven.

Ali, problemi postoje i van Kine. Očekuje se da sa lošim ocenama nećete moći da koristite neke od mogućnosti sa Interneta. Npr. Airbnb neće dozvoljavati rezervaciju smeštaja, neke od društvenih mreža će vam blokirati profil ili nećete moći da koristite Google. Na sreću, do toga nije došlo – još uvek. Ipak, neke od velikih kompanija već koriste sisteme za „social scoring“ u svojim algoritmima intenzivnije nego što smo svi mi toga svesni.

Ali, problemi postoje i van Kine. Očekuje se da sa lošim ocenama nećete moći da koristite neke od mogućnosti sa Interneta. Npr. Airbnb neće dozvoljavati rezervaciju smeštaja, neke od društvenih mreža će vam blokirati profil ili nećete moći da koristite Google. Na sreću, do toga nije došlo – još uvek. Ipak, neke od velikih kompanija već koriste sisteme za „social scoring“ u svojim algoritmima intenzivnije nego što smo svi mi toga svesni.

Kako velike kompanije koriste „social scoring“ sisteme?

„Social score“ je zanovan na tragovima koje ostavljamo na Internetu. Posle procene, svaka osoba dobija svoju ocenu. Što je viša ocena, to je viši stepen privilegija koji neko ima. Prilikom generisanja ocene velike kompanije prate ponašanje korisnika Interneta. Tako odlučuju koje servise možemo, a koje ne možemo da koristimo.

Evo jednog ekstremnog primera. Model sa Interneta koja je na Instagramu i Twitteru pod imenom @lilearthangelk (https://twitter.com/lilearthangelk) je objavila na Twitter-u da će poslati svoju golišavu sliku svakome ko uplati 10 australijskih dolara na bilo koji od osam fondova koji finansiraju sprečavanje požara u divljinama Australije. Ona je na ovaj način prikupila više od milion dolara. Njene slike su donatorima slate korišćenjem opcije „Direct Message“ na twitter-u. Ipak, Instagram je u jednom trenutku obrisao njen nalog. Razlog je bio to što golišave fotogarfije narušavaju njihov kodeks ponašanja na mreži. U ovom slučaju je Instagram bio na neki način upoznat sa Twitter kampanjom.

Ali, i u slučaju kad niste toliko popularni i poznati, vi ostavljate svoje podatke na Internetu. Mnogi vole da rezervišu smeštaj korišćenjem Airbnb-a jer je jeftinije i jednostavnije nego na druge načine. Ova kompanija koristi napredne softvere i primenjuje veštačku inteligenciju kako bi „skenirala“ vaše profile na Internetu.

Ali, i u slučaju kad niste toliko popularni i poznati, vi ostavljate svoje podatke na Internetu. Mnogi vole da rezervišu smeštaj korišćenjem Airbnb-a jer je jeftinije i jednostavnije nego na druge načine. Ova kompanija koristi napredne softvere i primenjuje veštačku inteligenciju kako bi „skenirala“ vaše profile na Internetu.

Koji podaci se prikupljaju i kako?

Još 2017. Airbnb je kupio Trooly, kompaniju čiji softver sadrži ono što se naziva „predictive policing“. To je softver, sada deo Airbnb, koji prikuplja sve moguće podatke koje nađe o korisniku na Internetu. I to ne samo vaše javno objavljene podatke i postove na društvenim mrežama. Ovaj softver pronalazi baš sve što se može pronaći. Tako da, ako ne brišete često „kolačiče“ (cookies) iz svog pregledača Interneta, Airbnb će se vrlo dobro upoznati sa vašom istorijom pretraživanja Interneta. Ovo važi čak i za naloge koji nisu povezani sa vašim pravim imenom – i oni mogu da ih dovedu do vaših pravih podataka.

Svi ovi podaci se koriste kako bi se otkrili obrasci u vašem ponašanju. Prema nekim istraživanjima, Airbnb tvrdi da može da otkrije „neurotizam i uključenost u izvršavanje zločina“, kao i „narcizam, makijavelizam ili psihopatiju“. A sve to se doživljava kao karakteristike osobe kojoj se ne može verovati. Dakle, algoritam prikuplja sve podatke i ocenjuje vas kao ličnost, a Airbnb donosi odluke zasnovane na toj proceni.

Svi ovi podaci se koriste kako bi se otkrili obrasci u vašem ponašanju. Prema nekim istraživanjima, Airbnb tvrdi da može da otkrije „neurotizam i uključenost u izvršavanje zločina“, kao i „narcizam, makijavelizam ili psihopatiju“. A sve to se doživljava kao karakteristike osobe kojoj se ne može verovati. Dakle, algoritam prikuplja sve podatke i ocenjuje vas kao ličnost, a Airbnb donosi odluke zasnovane na toj proceni.

Drugi podaci koji se na Internetu mogu prikupiti o vama odnose se na alkohol, drogu, grupe koje izražavaju mržnju, ili se odnose na seks i pornografiju. Sve to donosi nižu ocenu. Softver, takođe, pretražuje medijske izveštaje da pronađe podatke o uključenosti u kriminalne aktivnosti. Na kraju svega, softver odlučuje da li možete ili ne možete da iznajmite određeni smeštaj za svoj odmor korišćenjem Airbnb-a. Možete imati savršenu ocenu na samoj Airbnb platformi, ali se takođe računa i ono što se o vama nalazi van nje.

Postavlja se pitanje: da li je u redu da softver donosi odluke o vama koristeći samo podatke koji su mu dostupni? Bez uvida u druge vaše reference, kriminalni dosije ili kreditne izveštaje? I ne radi se samo o tome da li ćete moći da rezervipete smeštaj preko Airbnb-a ili ne. I osiguravajuće kompanije već koriste softver za „social scoring“. Verovali ili ne, vaše objave na društvenim mrežama mogu bitno da utiču na vaš život. Takođe, i poslodavci pažljivo osmatraju profile na društvenim mrežama potencijalnih novih radnika. Njihove personalne službe vrlo često rade ozbiljne provere pokušavajući da pronađu sve relevantne informacije. Tako se može desiti da vaš sledeći intervju za posao bude otkazan zbog vaših postova od pre mnogo godina na nekom od profila koje imate na mrežama.

Koje su druge moguće posledice u budućnosti?

Tehnologija koja može da kreira obiman sistem za „social scoring“ je već dostupna. I hardver, i kamere za prepoznavanje lica (koje se već koriste i u Kini, i u nekim zapadnim zemljama), kao i softver – sve već postoji. Velike kompanije več imaju dosta iskustva u radu sa velikom količinom podataka.

Za građane nekih zemalja GDPR (General Data Protection Regulation) donosi neku vrstu zaštite. Jer, GDPR otežava neke od pretraga koje se mogu obaviti. Ali, nije najveći problem korišćenje ličnih podataka i narušavanje privatnosti kada govorimo o „social scoring-u“. To je ono što se danas naziva „extralegal punishment“, a što bismo preveli kao vanpravno kažnjavanje. To znači da se pojedinac kažnjava van pravnog sistema, i to od strane privatnih kompanija. Tu se osumnjičenom pojedincu niti pretpostavlja nevinost, niti daje šansa da se brani. Ali, sa druge strane, to su privatne kompanije i one mogu da odlučuju o tome ko može, a ko ne da koristi njihove usluge. Problem je što su mnoge od tih platformi danas toliko velike i moćne, da se praktično mogu posmatrati kao infrastruktura.

Za građane nekih zemalja GDPR (General Data Protection Regulation) donosi neku vrstu zaštite. Jer, GDPR otežava neke od pretraga koje se mogu obaviti. Ali, nije najveći problem korišćenje ličnih podataka i narušavanje privatnosti kada govorimo o „social scoring-u“. To je ono što se danas naziva „extralegal punishment“, a što bismo preveli kao vanpravno kažnjavanje. To znači da se pojedinac kažnjava van pravnog sistema, i to od strane privatnih kompanija. Tu se osumnjičenom pojedincu niti pretpostavlja nevinost, niti daje šansa da se brani. Ali, sa druge strane, to su privatne kompanije i one mogu da odlučuju o tome ko može, a ko ne da koristi njihove usluge. Problem je što su mnoge od tih platformi danas toliko velike i moćne, da se praktično mogu posmatrati kao infrastruktura.

Tako dolazimo do toga da model kao što je @lilearthangelk može da ostane bez dobrog dela svoje vidljivosti na Internetu, a time i bez dobrog dela svojih obožavalaca. Ili do toga da neko ko na slici drži u ruci čašu sa pićem neće moći da radi kao vozač Uber-a. To su već ozbiljni problemi.

Šta je rešenje?

Ako znamo da se svaki naš post i svaka fotografija ocenjuju, čak i na anonimnim profilima, mnogi od nas bi verovatno bili mnogo pažljiviji u onome kako se ponašaju na Internetu. Možda ne bismo iznosili svoje mišljenje kao što smo to radili ranije. Povukli bismo se u svoju privatnost, dalje od društvenih mreža. A to ne bi bilo poželjno za Facebok i ostale. Na kraju, svaka društvena mreža očekuje i ima potrebu za sadržajima koje korisnici postavljaju onlajn.

Šta vi mislite? Da li Airbnb ili Uber mogu da koriste sisteme za ocenu ličnosti pojedinca kao relevantne i za veću bezbednost korisnika? Da li ljudi koji se ponašaju ne-etički treba da imaju mogućnost za korišćenje Instagrama? Ili, da li je invazivan monitoring koji primenjuju velike kompanije opasan? Razmislite dobro…